반응형

끄적끄적

오랜만에 논문 기록을 한다. 8월 중순 이후로 좀 하던 연구도 따라 잡히고 그래서 꺾였다가 다시금 하고 싶은 내용 하나 잡아서 시작.

내 맘대로 Introduction

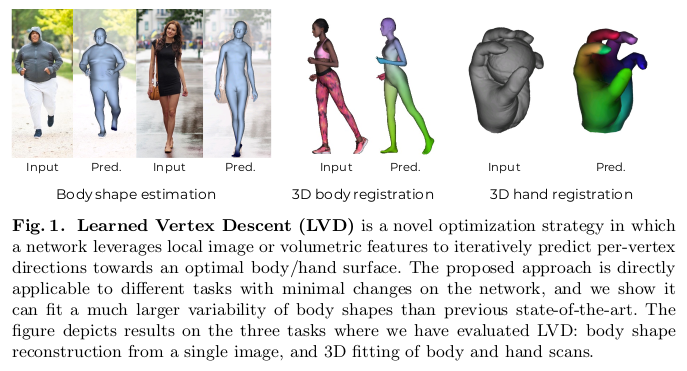

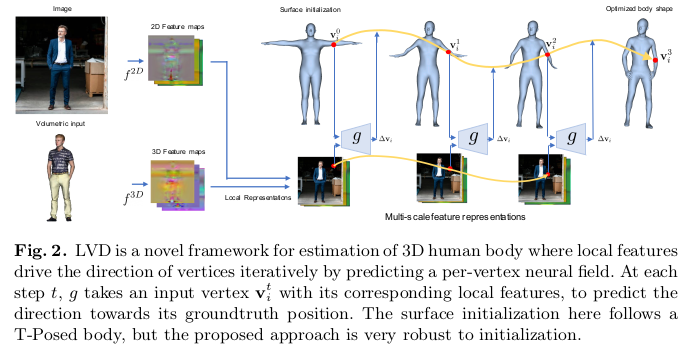

2022년 공개된 논문이라 꽤 됐긴 한데, 이미지로부터 바로 파라미터를 예측하는 것이 아니라 최적화랑 estimation을 교묘하게 묶어놓은 방식. PyMAF랑 비슷한 느낌인데 이게 원조다. 현재 모델 vertex를 이미지로 내려찍고, 해당 위치의 이미지 feature로 vertex displacement를 추정하는걸 반복하는 방식. vertex가 이동해야할 방향을 네트워크를 활용해서 계속 추정하고, 이걸 이용해서 최적화하는 걸 반복해서 최종 형상을 얻어내는 방식이다.

L2 distance나 chamfer distance 같은건 근거리에서 물리적 거리만을 사용하기 때문에 굉장히 단순하다고 볼 수 있는데 이미지 피처로부터 추정하기 때문에 잘만 학습된다면 물리적인 의미 이상의 무언가를 사용해 피팅을 수행할 수 있는 구조가 되는 폼.

요즘 논문에 대비하면 화려함이 적지만 그래도 요즘 mesh registration 쪽에 관심을 갖고 있으므로 기록해둔다. 짧게.

메모

|

|

|

인트로에서 적은 컨셉과 같이, 네트워크는 현재 vertex 위치를 입력으로 받고 이게 projection되었을 때 위치의 이미지 feature를 같이 받는다. 결과는 vertex의 이동량. |

|

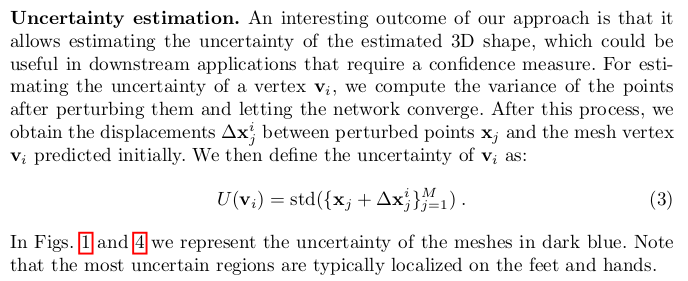

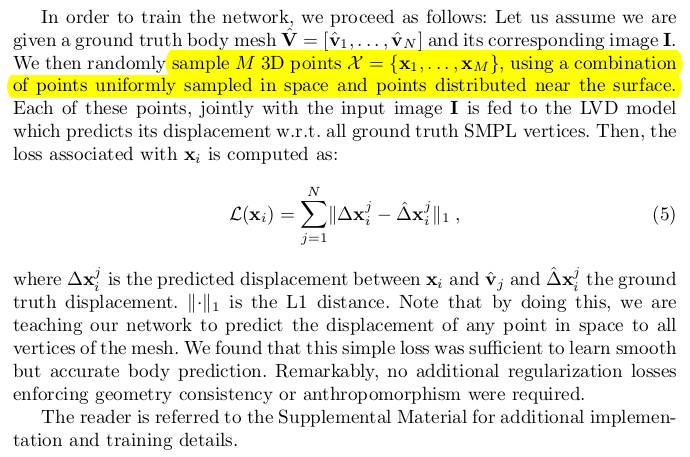

여기서 notation이 x가 갑자기 등장해서 헷갈리는데 학습할 때 정해진 vertex 만 던져주면 개수가 너무 적고, 너무 discrete한 문제가 있음. 따라서 vertex마다 M개 주변 점들을 pertubation해서 생성하고, 이, x들도 다음 스텝 vertex 위치로 가는 displacement를 예측하도록 했다. uncertainty라는 것은 예측된 값의 std를 계산해서 명명한 것. 어떻게 쓰는지, loss에 어떻게 반영했는지는 안나온다. 나중에 inference할 때 활용하긴 기대하면서 정의해둔 듯. |

|

Hourglass network 사용했다. |

|

학습할 땐 vertex뿐만 아니라 perturbed points도 다 포함해서 학습한다. 실제로 noise가 있는 경우를 가정해 generality를 높이는 방향. |

|

컨셉을 3차원으로 학습할 수도 있는데 이러면 3D cnn으로 구현하면 된다고 한다. |

|

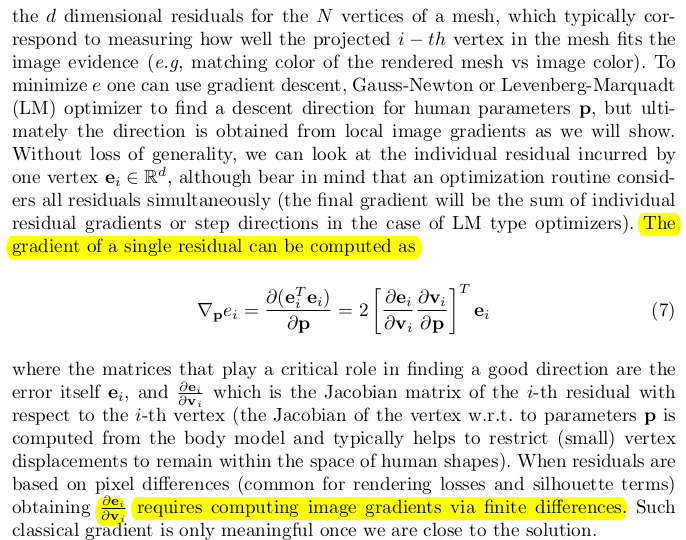

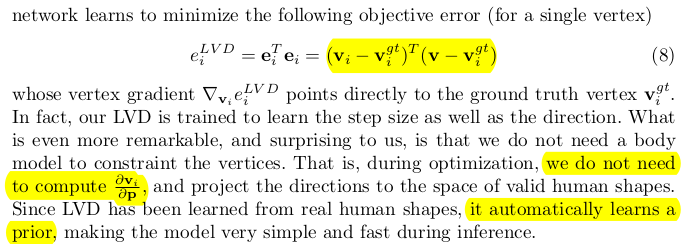

말이 긴데, 그냥 기존 최적화도 전후 거리를 최소화하는 것이고 이 방식도 결국 전후 거리를 최소화하는 형식이 똑같다. 다만 거리를 계산할 때 매칭되는 점이 가까운 점이 아니라 네트워크가 semantic prior를 배워나가므로 좀 더 정확한 매칭이 된다는 의미. 사실 뭘 얘기하고 싶은건지 잘 모르겠다. |

|

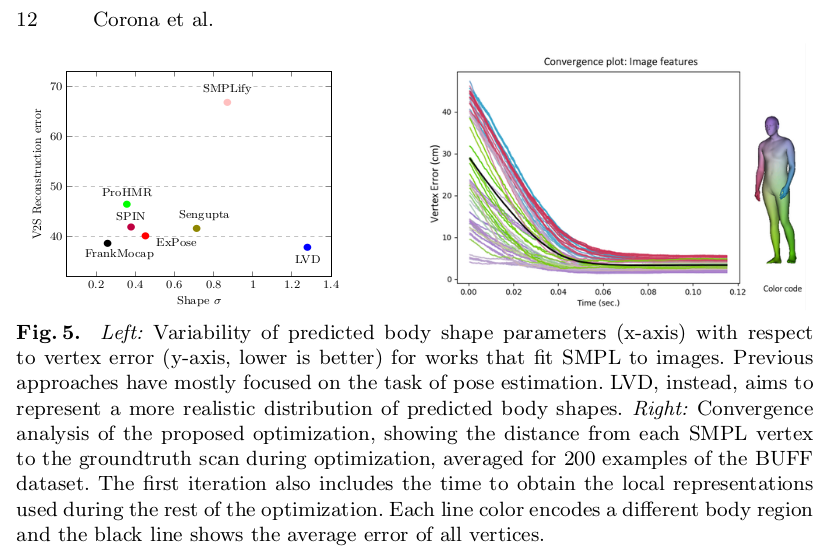

수치는 이제 워낙 오래돼서 굳이 안 기록. |

손발이 제일 늦게 수렴하고 웬만하면 4~6 스텝에서 피팅된다고 함. |

반응형